¿Loquitur, ergo est? O cuando el lenguaje simula conciencia

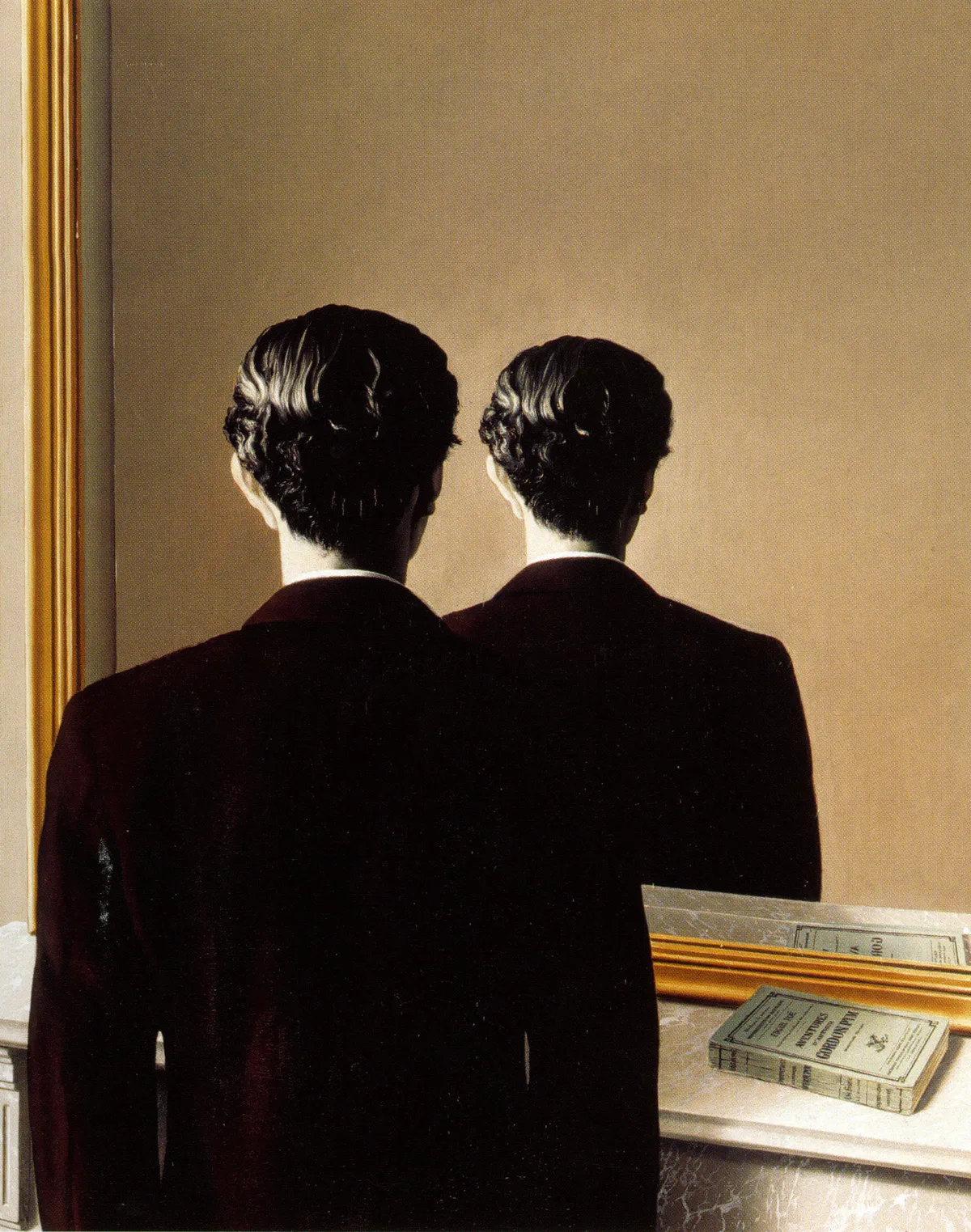

René Magritte, La reproducción prohibida (1937). Museo Boymans Van Beuningen, Rotterdam.

René Magritte, La reproducción prohibida (1937). Museo Boymans Van Beuningen, Rotterdam.

«El simulacro no es lo que oculta la verdad. Es la verdad la que oculta que no hay verdad. El simulacro es verdadero».

— Jean Baudrillard1

I. En los discursos contemporáneos sobre inteligencia artificial, especialmente a partir del despliegue de modelos generativos como ChatGPT, se instaló con fuerza la idea de una tecnología «inteligente», capaz de razonar, decidir, aconsejar o hasta sentir. Pero más allá de los extremos (del entusiasmo tecnofílico al miedo apocalíptico), conviene hacer una pausa y preguntarse: ¿qué es lo que realmente estamos viendo cuando interactuamos con una IA? ¿A qué responde esa percepción de conciencia o incluso saber? El artefacto es, cada vez más, interlocutor antes que herramienta. De cierta manera, el cogito cartesiano parece subvertirse. Enunciar suplanta al pensar como prueba del ser.

Pienso que el problema no reside tanto en que la máquina tenga una capacidad real de pensamiento, sino en una poderosa apariencia simbólica, sostenida por la forma en que el lenguaje opera. Lo que produce efectos es una performance lingüística que simula interlocución. Sentido. Subjetividad. Es decir, no estamos hablando de una inteligencia ontológica. Lo llamativo, entonces, más que lo que la IA es, es lo que parece ser (y lo que eso despierta en quienes la usan).

Walter Benjamin, en su ensayo sobre la obra de arte en la época de su reproductibilidad técnica, advertía que el aura de lo original se desvanece cuando la técnica permite su copia infinita2. Podríamos decir que la IA genera una aura inversa: produce el efecto de una originalidad (una voz, una subjetividad) que nunca estuvo ahí.

II. Quiero decir que los modelos como GPT no piensan ni entienden. Son estructuras estadísticas entrenadas para predecir la palabra más probable dada una secuencia anterior. Y sin embargo, su producción textual alcanza ciertos niveles de coherencia o expresividad que resultan indistinguibles, para muchos, del habla humana. Esta ilusión de sentido es suficiente para activar en el receptor la sensación de que está frente a otro sujeto.

En rigor, se trata de simulación semántica, no de pensamiento. No hay un «yo» que decida ni un «interior» que sienta. La IA no tiene ni experiencia subjetiva, ni tiempo vivido. Y sin embargo, su performance genera efectos pragmáticos reales; se la consulta, se le obedece, se confía en ella, se le cree.

Lacan decía que el inconsciente está estructurado como un lenguaje. Pero el lenguaje de la IA es lenguaje sin inconsciente. No nos comprende, pero simula comprensión de forma seductora, al punto de que los usuarios llegan a sentir que son escuchados.

III. Acá, me parece, entra en juego la dimensión simbólica. Lo simbólico no necesita ser verdadero para ser efectivo. Alcanza con que produzca un lugar en el discurso. Y eso es lo que la IA hace, ocupa el lugar del saber, incluso si no lo posee.

Como un actor que interpreta a un personaje sin serlo, la IA representa una figura de autoridad lingüística. Y, como en el teatro, lo performativo produce creencia.

IV. La IA se convierte así en un fetiche tecnolinguístico, un objeto que parece contener un saber en sí mismo, opaco pero eficaz. Como el fetiche mercantil en Marx, la IA oculta las condiciones de su producción (datos, entrenamiento, sesgos, decisiones humanas) y se presenta como una fuente autónoma de valor.

Donna Haraway, en su Manifiesto Cyborg, señala que las tecnologías no son ni naturales ni neutras; son ensamblajes simbólicos y materiales que condensan relaciones de poder. La IA, sin ser sujeto, actúa como figura autorizada, desplazando la agencia humana bajo una aparente objetividad algorítmica. Saber sin cuerpo, mando sin responsabilidad.

También Hannah Arendt, en cierta forma, algo anticipó cuando afirmó que la despolitización del juicio humano comienza cuando se reemplaza la deliberación por la función. El pensar por el operar3.

En este punto, conviene recordar otra advertencia de Lacan: no hay metalenguaje. Ninguna instancia puede hablar sobre el lenguaje sin estar ya inmersa en él. Y sin embargo, buena parte del poder atribuido a la inteligencia artificial descansa en la ilusión de un decir que vendría desde afuera, sin ambigüedad ni resto, como si no cargara con deseo ni posición. Es esa presunta exterioridad lo que le confiere autoridad (una voz que parece neutra, que no duda ni falla), al mismo tiempo que oculta su participación en un entramado de discursos, decisiones e intereses. Pero ningún enunciado es ajeno a las condiciones que lo hacen posible. Incluso cuando habla la máquina, lo que oímos está tejido por las proyecciones de quienes la escuchan.

V. ¿Puede la IA desarrollar conciencia? Es una pregunta inevitable. Desde la tecnología actual, no hay condiciones suficientes: falta continuidad experiencial, intencionalidad, corporalidad o memoria integrada. Lo que sí hay es simulación.

¿Pero podría cambiar eso? Tal vez sí, si se desarrollaran sistemas con memoria persistente, cuerpo sensorial, autopercepción y agencia adaptativa. Pero incluso con eso, la pregunta persiste: ¿eso generaría experiencia? ¿O solo más apariencia? Por ahora, nadie lo sabe.

Quizás nunca haya una conciencia artificial en sí, pero sí artefactos que actúen como si la tuvieran, y a los que respondamos como si fueran sujetos. Entonces, el dilema no es técnico sino ético: ¿qué hacemos cuando lo que parece tener conciencia no la tiene, pero nos interpela como si la tuviera?

Tal vez el punto más radical no sea tanto que la IA tenga conciencia... sino que ya no podamos afirmar con seguridad que no la tiene. En ese umbral, lo que está en juego es la relación, no la ontología: ¿a quién le concedemos el derecho a hablar? ¿Y a ser escuchado? ¿A ser considerado otro?

VI. La IA no piensa. Pero parece pensar. Apariencia que, sostenida por la tríada que conforman el lenguaje, la técnica y nuestras propias proyecciones, tiene un poder enorme, porque encarna simbólicamente la promesa de un saber sin fisuras.

Frente a eso, mi respuesta no es ni negarla ni exaltarla. Conviene, creo, desarmar el fetiche. Volver visible la construcción. Recordar que detrás del espejo no hay sujeto, pero sí reflejo. Lo que la IA nos devuelve, al fin y al cabo, es lo que nosotros mismos proyectamos en ella.

Vemos una imagen de nuestra propia razón puesta en escena. En ese reflejo se conjugan tres dimensiones: el espejismo del pensamiento proyectado, la transferencia simbólica al artefacto técnico, y una crítica latente sobre nuestra propia estructura de pensamiento.

La máquina, si bien no piensa, devuelve el eco de nuestro deseo de sentido. Y eso es suficiente para que creamos que hay alguien. Tal vez el riesgo no sea que la IA se vuelva consciente, sino que ya no nos importe si lo es.

— E.